AIベースのアプリケーションが企業組織に浸透しつつある。ここでは、それらを適切に活用するための方法を紹介する。

この9か月間は、AIが大きな注目の的となり、多くの潜在的な可能性と不安材料が混在している。しかしAIは、今後も定着していくだろう。企業の運営方法や、顧客と関わり方を変革する時が来ているのだ。

AIベースのアプリケーションが企業組織に浸透していく中で、それらを適切に活用できるようにする方法を紹介しよう。

AIの長所と短所

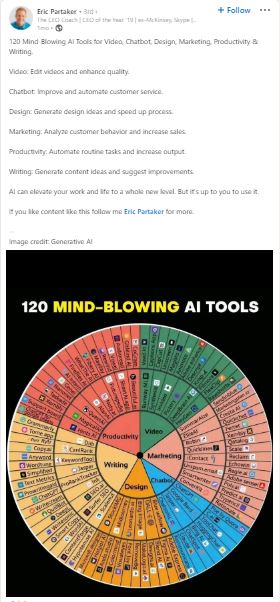

日々同僚から聞くのは、生成AIを使用してプロセスを高速化したり、コンテンツを作成したりする方法だ。ある同僚は、120個の生成AIツールを示すグラフィック(生成AIによって作成されたものだ!)を含むEric Partaker氏のLinkedInへの投稿を転送してきた。私にとって、宝の山である。

創造的な取り組みにAIを活用するあらゆる方法を提供する企業が、どこからともなく現れたように見える。しかし、生成AIが想像力を魅了しているのと同じくらい、ほぼすべての業界や顧客の接点において顧客体験を変革するAIの潜在的な可能性こそが、最終的に興奮を引き起こすだろう。

私は昨日、簡単なはずの近距離フライトの予約に45分間も費やしてしまった。クリックした画面の数は数え切れない。私はいつか、自然言語インターフェイスを使って、AIを駆使したアシスタントに、いつ、どこに行きたいかを伝えるだけで、それを手配してくれるという大変な仕事を任せることができる日を思い描いている。

しかし、正確性やハルシネーション(AIが事実に基づかない情報を生成する現象)に対する懸念から、AIが人類を滅ぼすという懸念まで、恐怖、不確実性、疑念は依然として存在する。ある大学教授の友人が、Facebookで皮肉を込めた投稿をしていた。

「私は新しいコースを開発するために、ChatGPTと多くの仕事をしている。それに際し、以下の2つの前提のもと、私は常に礼儀正しい態度でプログラムとの対話に臨んでいる。(1)私がChatGPTに書いたすべてのものは永久に保存されるだろう。(2)もし私がまもなく支配者になるだろうAIに優しく接していれば、おそらく、彼らも私に優しくしてくれ、どこか僻地の鉱山植民地に私を送り込むことはないだろう……」。

私たちはどこへ向かうのか

あなたの立場に関係なく、AIの存在と、あなたのビジネスに影響を与えるだろうことを受け入れる時が来ている。ただし、まだ突然「スイッチが入る」という瞬間が訪れる可能性は低い。AIベースのテクノロジーアプリケーションは、他のほとんどのテクノロジーと同様に、1つ1つの製品から展開されていくだろう。

多くの場合、AIテクノロジーは、最初は、業務や機能に漸進的な変化をもたらす。やがてAIテクノロジーが進化するにつれて、ワークフローが最適化され、顧客との接点がよりインテリジェントになる。そして、より大きな影響が見られるようになるだろう。

マーケティングの観点からは、AIをどこで、どのように使用するかを網羅する戦略を持つことが不可欠である。全員が共通のルールに従って作業するためのレールを確立し、データをさまざまなAIアプリケーションで活用できるようにする計画を立てる必要がある。

それにはまず、自分の役割を明確にすることが第一歩である。

- あなた、あなたの会社はAIユーザーか、AIプロバイダーか、その両方か?

- あなたはAIツールを活用している側なのか、AI対応ツールを提供している側なのか?

私たちのほとんどはAIユーザーであろうが(ChatGPTの普及がそれを示している)、一部の人々はAIプロバイダーでもあるだろう。

AIユーザーとして考慮すべきこと

マーケティング活動の一環としてAIを活用する戦略を検討する際には、生成AIアプリケーションを他のAI対応のアプリケーションと区別して見ることが重要である。

生成AIアプリケーションを使用するには、外部のインターフェイスを使用する必要がある。内部データへの依存はなく、セキュリティリスクもほとんどない。先の図が示すように、現在では多くの生成AIツールから選択することができる。

生成AI機能は、既存のアプリや製品にも搭載されつつある。たとえば、アメリカで開発されたインバウンドマーケティングのプラットフォーム「HubSpot」には、コンテンツの作成と推敲を支援するAIアシスタントが統合されている。

あなたのチームメンバーは、すでにこれらのツールを使ってコンテンツを作成・編集している可能性がある。まだそうしていないのであれば、貴社における生成AIの使用に関するパラメーターを設定し、以下のことに取り組もう。

- どのツールの使用が承認されているか。また、新しいツールの使用承認をどのようにして得るか。

- いつ、どのようにこれらのツールを使うべきか。

- コンテンツの作成とコンテンツの編集。

- コンテンツのプロパゲーション(伝播)。生成AIを使用する際の本当のリスクの1つは、配信されるコンテンツの量を増やすために使用されることである。これはパーソナライゼーションに役立つ場合は良いことかもしれないが、見込み客や顧客に浴びせる目的で本質的に同じコンテンツの複数のバージョンを作成するために使用されるのであれば問題だ。私はよくGoogle BardやChatGPTを使って自分が書いたコンテンツを推敲してもらい、「これを改善する」や「これを書き直す」などのコマンドを使用する。それを何度も繰り返して同じコンテンツの適切なバリエーションを複数取得し、それらのバリエーションを投稿やメールなどに使うことは、自身のマーケティング活動を強化するどころか、弱めてしまうコンテンツを作り出しかねない。

- これらのツールで作成されたコンテンツは、どのように帰属させるべきか。著作権はどのように扱われるのか(法務部門に相談する時だ)。従業員がコンテンツ作成に生成AIを使った場合、それを開示すべきか。もしそうなら、いつ、どのようにすればよいか。

- これらのツールによって作成された参考文献を引用する場合、どのようにファクトチェックするか。 私たちは、生成AIが誤った参考文献を作成する可能性があることを知っている。このことにどのように対処したらいいか。

- コンテンツ倫理 今では他人の声を使って音声ファイルを作成するために生成AIを使用できるようになっている。これについてどう考えるか。

私たちは新たな領域に足を踏み入れている。そこでパラメーターやガイドラインを確立するために、チーム全体を巻き込むことをお勧めする。これらは、新しいアプリケーションや表面化した問題に対処するために定期的に見直す必要があるものだ。

現在、マーケティングに関しては、AIと生成AIを区別なく使用する傾向にあるが、他の多くのAI対応のアプリケーションはマーケティングスタックに価値を加えることができる。これらのアプリケーションのほとんどは、見込み顧客のターゲティング、顧客エクスペリエンスの作成と改良、パフォーマンスの分析、その他のマーケティング機能で価値を提供するために、データを使用する。

「garbage in/garbage out(ゴミを入れればゴミしか出てこない。転じて、コンピュータがどんなに高性能でも、不完全なデータを入力すれば、不完全な答えしか得られない、の意)」という古い言葉を覚えているだろうか。ここでも同じことが言える。データがクリーンで、完全で、アーティファクト(信号処理や画像処理の過程で発生するデータの誤り)がなければ、これらのアプリケーションから何の利益も得られないということである。

多くのマーケティング部門が、どのようなデータを持っているか、それがどこにあるのか、アプリからアプリへの受け渡しはどうなっているのか、データはどの程度クリーンなのか、そしてどのようなデータが欠けているのかについて、明確な見解と理解を持っていないことに私は驚かされ続けている。

もしあなたの部署がこのような状況であるのなら、今こそスタックの詳細、関連するデータ収集、保管、共有、配布のシステムを文書化し、必要なものがすべて収集、保管、共有、配布されていることを確認するために行動を起こす時だ。

AIはやがて、あらゆるマーケティング・テクノロジー・アプリケーションに導入されるようになるだろうが、それは、クリーンで完全かつ正確なデータセットを使用している場合にのみ、うまく機能するだろう。

AIプロバイダーとして考慮すべきこと

貴社がAI対応アプリケーションのプロバイダーであれば、マーケティング・リーダーとして、貴社のアプリケーションがAIをどのように活用するのか、また、なぜAIを活用するのか、そしてAIを活用することで顧客にどのようなメリットがもたらされるのかを伝えることを、自然と考えなければならない時が来るだろう。

貴社がAI倫理についてどのように考えているかを伝えることは、今は頭の片隅にもないかもしれない。しかし、データプライバシーコンプライアンス情報をどのように公表しているかと同様に、AI倫理声明の公表についても考えるべきなのである。

これは、見込み顧客、特にその情報セキュリティ部門が、資格認定プロセスの一環として検討したいと思うような、早急な対応求められるものになるだろう。今こそがその時なのだ。

Salesforceは以前からAI倫理について話しており、また米国のソフトウェア企業Adobeや、米国の合成メディア企業WellSaid、カナダのサウンドテック・スタートアップ企業Resemble AIなど、AI倫理に関する声明を発表する企業も増えている。

対外的には、AIの安全性に取り組む団体がいくつか結成されている。それらには以下の団体が含まれる。

・Institute for Human-Centered Artificial Intelligence

米国政府もAIの安全性に取り組もうとしており、AI権利章典(米国科学政策局が作成を進めているAIに関する指針)を提案している。また、同政府は、テクノロジー業界のリード企業(Amazon、Anthropic、Google、Meta、Microsoft、Inflection、OpenAI)を招集し、AI開発のテストと安全確保、AIが生成したコンテンツの電子透かし(データに特定の情報を埋め込むことによって、オリジナルかどうか判別できるようにする技術)へのコミットメントを確立している。

こうした外部の取り組みは称賛に値するが、各AI開発者が独自のAIの境界と倫理を確立する必要性が否定されるわけではない。実際のところ、AIやAIアプリケーションがどのように進化するかはわからないのだ。

開発のペースは、何が可能なのかを概念化する私たちの能力を超えるだろうと示唆されており、そのため、私たちが想像もしなかったような機能や新しいアプリケーションが登場することはほぼ確実である。

行動を起こす

AIベースのアプリケーションが企業組織に導入される中で、私たちの目標は、それらを適切に利用できる状態にあることを確認することである。つまり、以下を行動に移すことが重要となる。

- 社内でのAI使用ルールの確立

- データフローを含むテクノロジー・スタックの文書化を徹底し、データの質を高める

- AI対応製品のプロバイダーの場合は、AI倫理に関する立場を確立し、AI倫理声明を発表する